编辑|冷猫、泽南

本周四晚,谷歌开源了当前开源世界最强的模型家族 Gemma 4 系列。

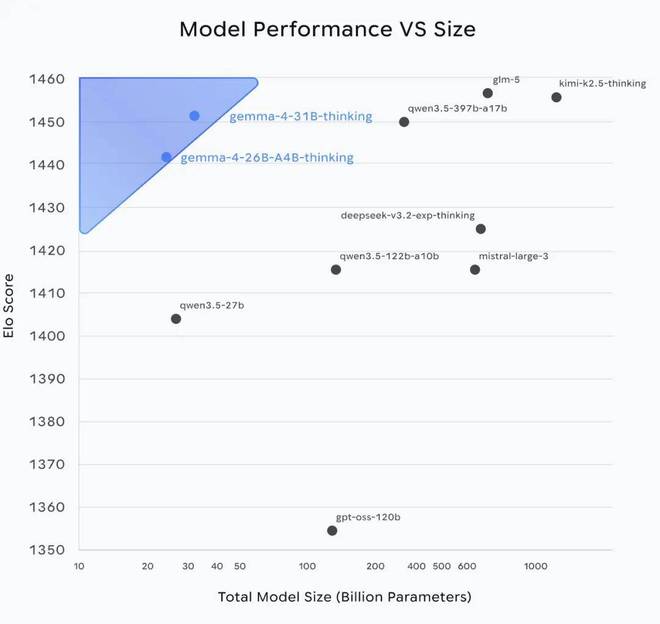

基于和 Gemini 3 相同的研究成果,新模型在 Arena AI 排行榜上拿到了全球第三的位置,而且超越了参数量比它大 20 倍的模型。更重要的是,这一代 Gemma 使用 Apache 2.0 开源许可证,可实现完全的商用自由。

Gemma 4 是 Google DeepMind 构建的最新开放模型系列,它们是多模态模型,用于处理文本和图片输入(小型模型支持音频输入)以及生成文本输出。此版本包含预训练和指令调优的开放权重模型。Gemma 4 的上下文窗口最多可容纳 25.6 万 token,并支持 140 多种语言。

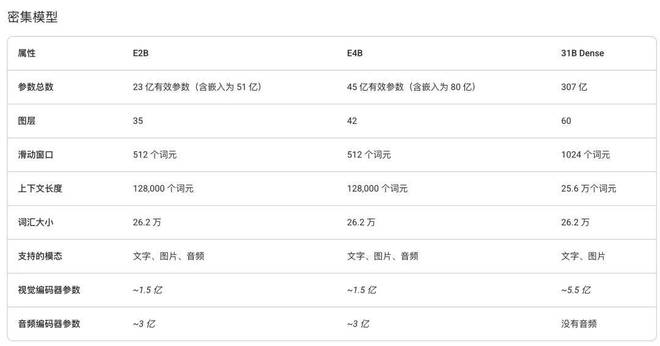

谷歌表示,Gemma 4 同时采用密集型架构和混合专家 (MoE) 架构,非常适合文本生成、编码和推理等任务。这些模型有四种不同的规模:E2B、E4B、26B A4B 和 31B。这些模型的大小各异,因此可部署在从高端手机到笔记本电脑和服务器的各种环境中,从而让更多人能够使用最先进的 AI。

其中,体量最大的 31B 版本使用一块 80GB H100 就能实现完整精度推理,可见其能力水平已经与 Qwen 3.5 397B 相当了。

体量最小的 E4B 和 E2B 专为手机、平板等端侧设备本地推理设计,谷歌也与高通、联发科进行了联合优化。

总的来说,Gemma 4 引入的功能和架构改进包括:

模型概览

Gemma 4 模型旨在在各种规模下提供前沿性能,目标部署场景涵盖移动设备和边缘设备 (E2B、E4B) 到消费类 GPU 和工作站 (26B A4B、31B)。它们非常适合推理、智能体工作流、编码和多模态理解。

这些模型采用混合注意力机制,将局部滑动窗口注意力和全局注意力交织在一起,确保最后一层始终是全局的。这种混合设计可提供轻量级模型的处理速度和低内存占用空间,同时不会牺牲复杂长上下文任务所需的深度感知能力。为了优化长上下文的内存,全局层采用统一的键和值,并应用比例 RoPE (p-RoPE)。

E2B 和 E4B 中的「E」表示「有效」形参。较小的模型采用 Per-Layer Embeddings (PLE),以最大限度提高设备端部署中的参数效率。PLE 不会向模型添加更多层或参数,而是为每个词法单元的每个解码器层提供自己的小型嵌入。这些嵌入表很大,但仅用于快速查找,因此激活参数的数量远小于总数。

26B A4B 中的「A」表示「有效参数」,与模型包含的参数总数相对。通过在推理期间仅激活 40 亿个参数子集,混合专家模型运行速度比其 260 亿个总参数所暗示的速度快得多。与密集型 310 亿参数模型相比,该模型几乎与 40 亿参数模型一样快,因此是快速推理的绝佳选择。

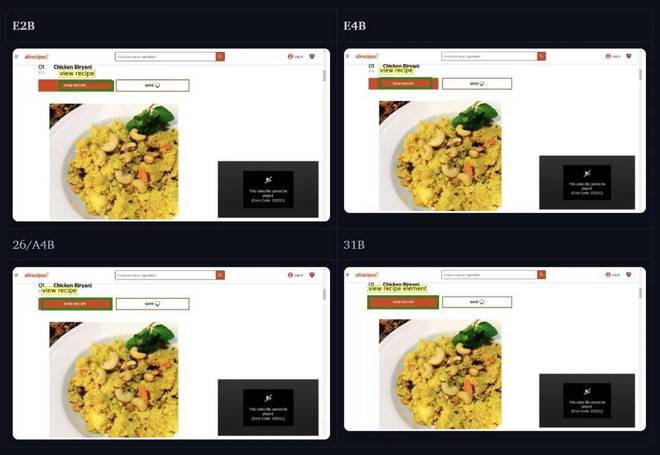

谷歌展示了一些 Gemma 4 的模型能力,比如测试它检测和指向 GUI 元素的能力:「图像中查看配方元素的边界框是什么?」

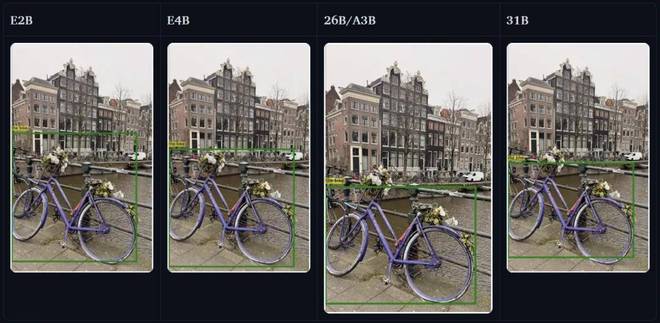

检测日常物体:

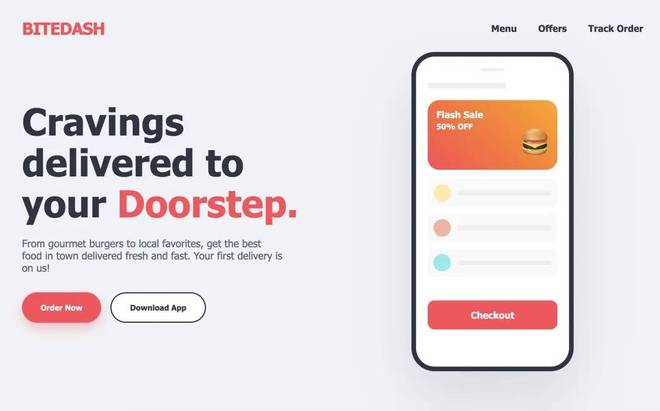

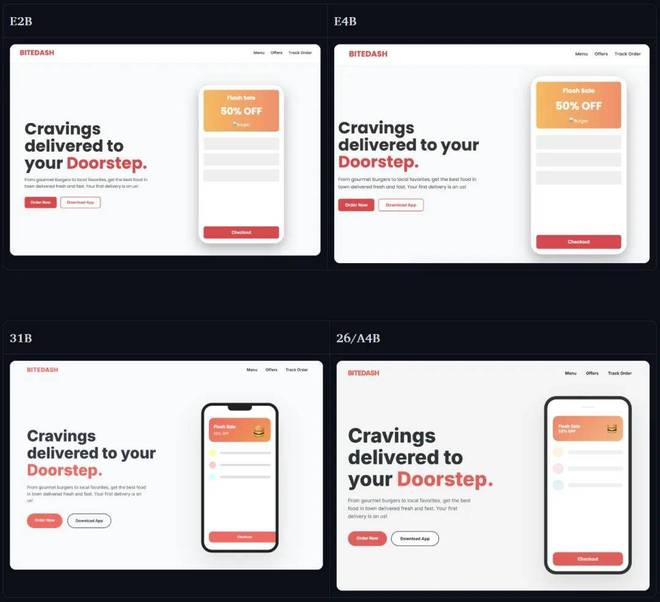

如果要求 Gemma 4 编写 HTML 代码来重建用 Gemini 3 创建的页面,Gemini 生成的网站是这样的:

Gemma 4 重建的页面:

参数大小和量化

Gemma 4 模型提供 4 种参数大小:E2B、E4B、31B 和 26B A4B。 这些模型可以采用默认精度(16 位),也可以通过量化采用较低的精度。不同的尺寸和精度代表着 AI 应用的一系列权衡。参数和位数(精度)较高的模型通常功能更强大,但在处理周期、内存成本和功耗方面运行成本更高。参数和位数(精度)较低的模型功能较少,但可能足以满足您的 AI 任务的需求。

Gemma 4 推理内存要求

下表详细列出了使用各种大小的 Gemma 4 模型版本运行推理所需的大致 GPU 或 TPU 内存。

表 1. 加载 Gemma 4 模型所需的大致 GPU 或 TPU 内存,具体取决于参数数量和量化级别。

内存规划的行动要点

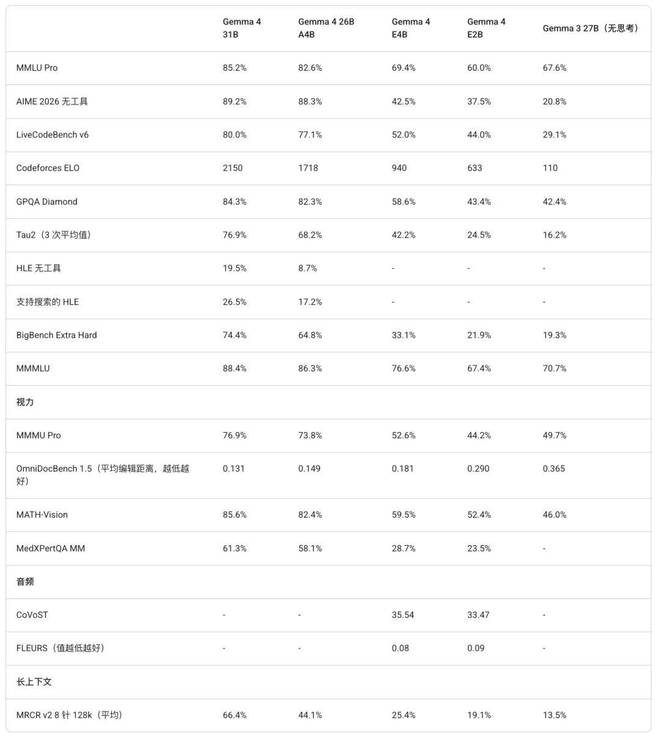

基准测试结果

我们针对大量不同的数据集和指标对这些模型进行了评估,以涵盖文本生成的各个方面。表格中标记的评估结果适用于指令调优模型。

核心功能

Gemma 4 模型可处理文本、视觉和音频方面的各种任务。主要功能包括:

训练数据集

谷歌使用的预训练数据集是一个大规模、多样化的数据集合,涵盖广泛的领域和模态,包括网页文档、代码、图片、音频,截止日期为 2025 年 1 月。以下是关键组成部分:

这些多样化数据源的组合对于训练强大的模型至关重要,该模型能够处理各种不同的任务和数据格式。

数据预处理

以下是应用于训练数据的主要数据清理和过滤方法:

参考内容:

https://deepmind.google/models/gemma/gemma-4/

https://x.com/Google/status/2039736220834480233

https://huggingface.co/blog/gemma4